Que passa amb les coses que fiques a ChatGPT?

On van els teus misteris més inconfesables?

Hola, amants de la IA! 👾

Avui us porto una reflexió per a tots aquells que, com jo, us heu trobat preguntant-vos: què passa amb la informació que fiquem a ChatGPT?

Però abans, recorda que si arribes al final, tens un consell no demanat per millorar la privacitat al teu ChatGPT, sí, al final.

Tornem.

Imagina que estàs buscant inspiració, o millor encara, respostes per solucionar aquest dubte existencial que et té embolicat des de fa dies.

Escrius en aquest xat brillant, i... PAM!. Allò que acabes d’escriure no només t’ajuda, sinó que també queda registrat. Però on, exactament? 🤔

Sí, ChatGPT sembla el millor company de confidències: silenciós, sempre disponible i amb respostes ràpides (encara que amb alguna desviació filosòfica, com si estigués intentant escriure el seu propi manifest).

Però com passa amb qualsevol confident, hi ha una qüestió inquietant de rerefons: què en fa, de les nostres paraules? Qui té accés a aquestes confessions digitals? I el més important: ens podem refiar d’ell?

Entre secrets i algoritmes indiscrets

La veritat és que, segons Caser Magazine, Wired i altres experts en ciberseguretat, hi ha algunes coses a tenir en compte per evitar disgustos, i com que ningú no vol veure les seves aventures inconfesables sortint com a resultat a alguna pregunta feta al ChatGPT per un senyor de Minsk, aquí us deixo algunes reflexions clau.

Primer de tot, ChatGPT, com qualsevol sistema d’intel·ligència artificial, recull i processa informació per millorar.

Això vol dir que, d’una manera o altra, les nostres dades passen per diversos filtres, i aquests filtres no sempre són igual de segurs. Aquí és on entra la part fosca de l’assumpte: per una banda, ChatGPT pot ser utilitzat per delinqüents per crear atacs de phishing (missatges enganyosos que semblen oficials) o per desenvolupar malware.

No seria la primera vegada que algun espavilat intentés aprofitar una IA per generar codis maliciosos que, tot i les restriccions, es poden colar per racons d’aquest immens ciberespai que compartim.

L’empresa d’OpenAI, creadora de ChatGPT, diu que el sistema no reté informació de manera indefinida i que pren mesures per protegir la privacitat, però el sistema pot registrar el que li introduïm, especialment en comptes no “anònims” que estiguin vinculats a una adreça d’usuari.

Què vol dir això? Doncs que cal ser prudents: res de noms, xifres sensibles, ni compartir allò que només li confessaries a un amic de carn i ossos. No és que ChatGPT estigui esperant per enviar la teva informació al malvat Sr. Pla, però, si pot ajudar, millor que no se sàpiga ni el teu número de sabates.

I ara, una mica de ciberhigiene! 🧼

Igual que ens rentem les mans abans de menjar, també cal “netejar” el nostre comportament digital.

A continuació, alguns consells per no perdre la tranquil·litat quan utilitzem ChatGPT:

Limita el tipus d’informació que comparteixes. Segons els experts, com més general sigui el que poses, millor. Evita incloure dades personals, perquè, encara que OpenAI aplica mesures de seguretat, sempre hi ha un risc residual. Només faltaria que ChatGPT acabés sabent més coses de tu que els teus propis amics!

Compte amb el phishing. Sí, els hackers s’aprofiten de les IA com ChatGPT per generar correus electrònics enganyosos, missatges sospitosos i altres formes de manipulació digital. Així que, alerta quan reps un correu que sembla fet per un geni, però que acaba amb un enllaç sospitós.

No tinguis por de ser “ciberparànoic”. No tot és el que sembla, especialment al món digital. Un consell útil? Evita confiar cegament en el que reps o comparteixes, ni que sembli la resposta més lògica i afinada del món.

El cas per a empreses: de l’ajuda a la indiscreció

Les empreses tenen, potser, més a perdre. ChatGPT pot ser una eina increïble per resoldre dubtes i inspirar-se, però no és recomanable compartir-hi informació sensible o dades empresarials, ja que aquestes podrien no estar tan protegides com s’esperava.

Les polítiques de privacitat de ChatGPT no estan dissenyades per a usos confidencials; de fet, empreses com Kaspersky i Qustodio recomanen evitar aquestes pràctiques o almenys estar sempre conscients dels riscos que implica.

Finalment, recordem que la tecnologia, com els éssers humans, no és infal·lible. I com més sofisticada és, més atractiva esdevé per a aquells que busquen escletxes. ChatGPT pot ser una gran eina sempre que la tractem amb una mica de respecte i precaució.

Per tant, mentre tu i jo ens continuem preguntant si ficar els nostres gustos gastronòmics perquè ChatGPT et faci un menú setmanal, fem també un esforç per mantenir la nostra informació segura i en bones mans.

Espero que aquesta reflexió us hagi servit per treure’n l’entrellat. La propera vegada que ChatGPT et pregunti “com puc ajudar-te?”, pensa dues vegades abans de compartir-hi el teu secret més preuat. 😉

Una pregunta inquietant

Si, segur?

Consell no demanat

Si et preocupa la privacitat de tot el que dius a ChatGPT; no és infalible, però no estaria de més que desactivis l’opció d'utilitzar tot allò que dius i fas amb el comú, és a dir, entrenar al model.

Prem al avatar superior dret.

Ara configuració.

Control de dades. I aquí a “Millora el model per a tothom” desactiva.

Voilà!

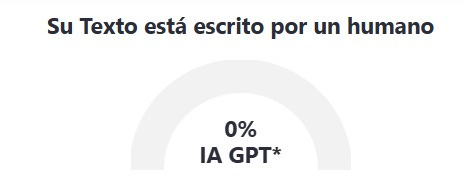

Ara ja no estàs compartint i ajudant a aprendre al model, has desactivat l’opció del que just ChatGPT deia que no feia per defecte.