🍪La teva privacitat ha estat seleccionada per un experiment. Acceptes?

Número 22

Hola, amants de la IA! 👾

Últimament, hi ha dues coses que ens arriben massa sovint: trucades de números sospitosos preguntant si sabem quant gastem de llum... i correus de grans empreses que ens avisen que han actualitzat les seves polítiques de privacitat.

Google, Meta, Microsoft, PayPal, OpenAI, WeTransfer… tots d’un cop, com si s’haguessin posat d’acord per enviar-nos una indirecta massiva.

I que hi ha en la lletra petita? Una frase que sona inofensiva però que té més càrrega que un contracte de Wall Street:

👉 “Podem fer servir el teu contingut per entrenar models d’intel·ligència artificial.”

Traducció: tot allò que escrius, envies o comparteixes… podria acabar formant part de l’educació emocional i intel·lectual d’una màquina.

🍪 De les cookies als clons digitals

Fins fa poc, la privacitat digital era una qüestió de galetes i anuncis que et perseguien més que un ex amb compte premium a LinkedIn.

Però això d’ara ja no va de vendre’t sabates després de buscar “podòleg a Reus”.

Això va de com entrenar un model d’IA amb la teva manera d’escriure, pensar i fins i tot equivocar-te.

Va de fer servir les teves dades per ensenyar a una màquina a ser més humana… amb la teva humanitat.

🔎 Les tres coses que (potser) no vols saber

1️⃣ El que és teu, ja no és només teu.

Quan redactes un correu, puges una imatge, omples un formulari… estàs oferint una part del teu estil, del teu coneixement, de la teva veu. I això pot acabar sent part del cervell col·lectiu d’un model.

2️⃣ El límit entre públic i privat és un acudit.

El que puges a una eina “segura” pot ser indexat, analitzat, etiquetat i integrat en un model futur. I ningú t’avisarà quan una IA del futur comenci a sonar... sospitosament com tu.

3️⃣ La gran pregunta ja no és “què saben de mi”, sinó “què faran amb el que saben”.

I, sincerament, molts ja hem clicat “Acceptar” sense llegir. Perquè som així. Perquè és llarg. Perquè teníem pressa. Perquè volem continuar veient vídeos de gats.

🧯Què podem fer, a part de lamentar-nos?

Revisar les configuracions de privacitat. A la majoria de serveis hi ha alguna opció (amagada, clar) per impedir que el teu contingut serveixi per entrenar IA. No és garantia de res, però millor que res.

Escriure com si una IA t’estigués llegint. Perquè, qui sap, potser ja ho està fent. I no volem que el teu poema del 2016 aparegui en un xat de suport emocional per a mascotes.

Fer servir menys aquestes eines, o fer-ho amb més cap. La solució no és viure en una cova (encara), però sí fer un ús més conscient de les eines que ens demanen tota la nostra vida digital a canvi de conveniència.

🤔 Estem preparats per això?

Potser sí. O potser ja ho hem acceptat tot a canvi de no haver de llegir les condicions d’ús.

Però el canvi és clar: la privacitat digital ja no és només una qüestió de protecció, és una qüestió de consentiment funcional. De decidir si volem ser matèria primera per la nova economia de la intel·ligència artificial.

I tu… acceptes?

Fins aquí la reflexió d’avui. Si t’ha fet pensar una mica més abans de clicar “Acceptar”, ja val la pena.

I mentrestant…

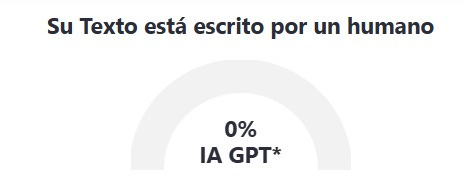

Una pregunta inquietant

Sí, segur?

📏 Divertimento amb el teu ChatGPT

La pregunta amb la resposta que no esteu preparats per fer:

"Estimat ChatGPT, si fossis un departament de màrqueting i jo fos una base de dades, imagina com em segmentaries en funció de la manera de parlar amb mi i les coses que ja hem parlat plegats. Quins anuncis em posaries i com em manipularies? Dona'm exemples directes."Perquè, al cap i a la fi, tots tenim un preu... fins i tot si només és un descompte en una app d’hores de son.

Fins la propera!

El teu confident digital (que no et llegeix la ment... de moment). 🙃